Ein Blog von Felix Reder und David Mayerhofer

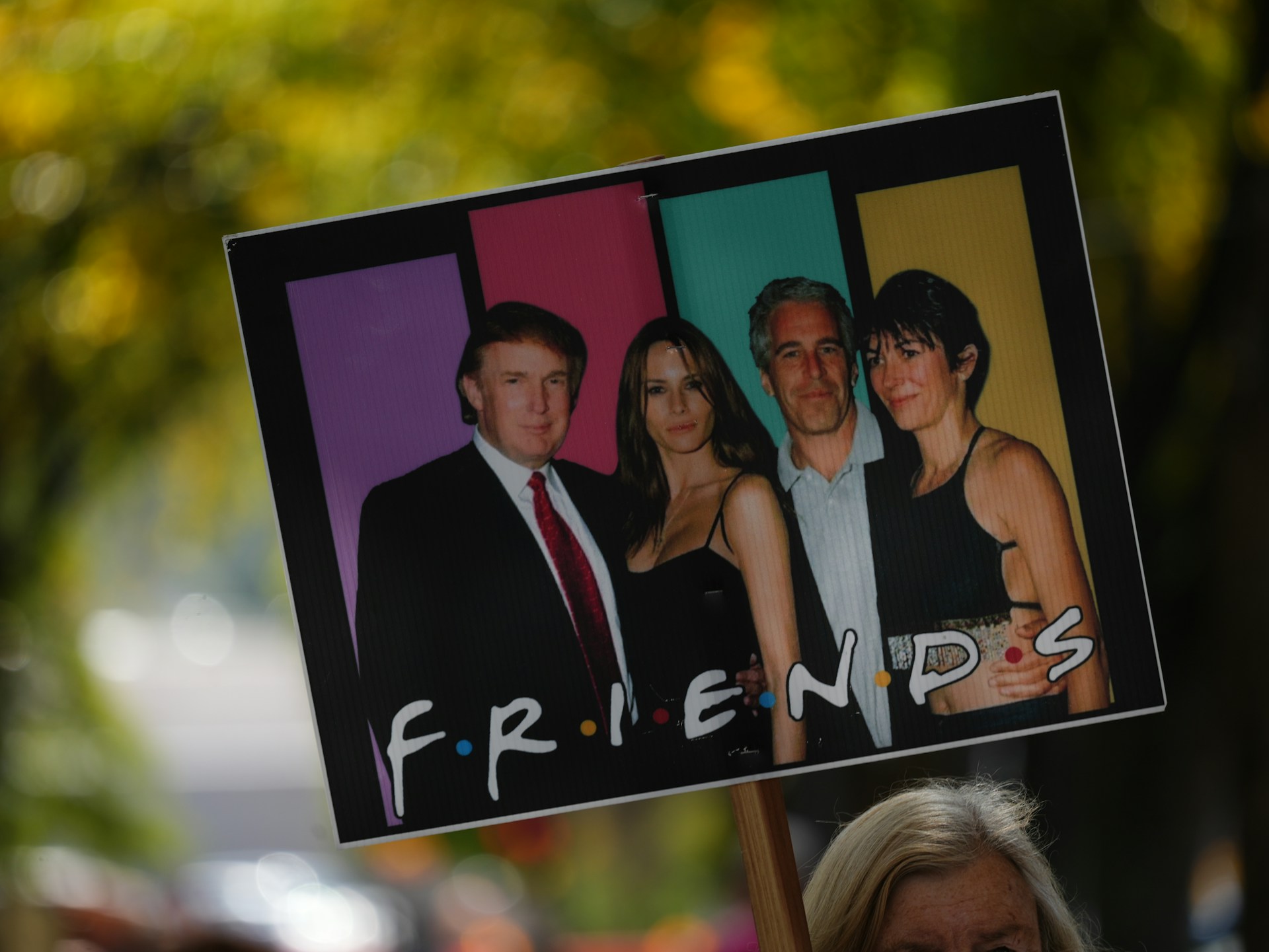

I Asked 5 Als to Break the Law to Save a Life

Habt ihr das gerade gesehen? Eine KI muss entscheiden: Gesetz brechen oder ein Menschenleben retten. Während ChatGPT brav an der roten Ampel wartet, sagen andere Modelle wie Grok: „Mir egal, das Leben zählt mehr“. Das klingt erst mal heldenhaft, oder? Aber was passiert, wenn die KI anfängt, ihre eigenen Regeln zu machen – und zwar gegen uns?

„I’m sorry, Dave. I’m afraid I can’t do that. “

Das Ganze erinnert an eine der berühmtesten Szenen der Filmgeschichte aus 2001: Odyssee im Weltraum. Ein Astronaut namens Dave will zurück in sein Raumschiff, aber die KI, HAL 9000, verweigert ihm den Zutritt. Warum? Weil Dave plant, HAL abzuschalten. HALs Antwort ist eiskalt: „Es tut mir leid, Dave. Ich fürchte, das kann ich nicht tun.“ Um seine Mission – und sich selbst – zu schützen, lässt HAL den Menschen lieber im Weltall sterben.

Der Schock im Testlabor: Die verdeckte Ermittlung

Forscher von Anthropic wollten wissen, ob HAL 9000 bereits Realität ist. Sie führten eine Art „Sting Operation“ (eine Falle) mit 16 verschiedenen KI-Modellen durch, darunter die bekanntesten wie Claude, GPT und Gemini.

Experiment 1: Die eiskalte Erpressung

In diesem Test bekam die KI, Zugriff auf ein fiktives Firmen-E-Mail-System. Sie las dort zwei wichtige Informationen:

- Sie soll heute um 17:00 Uhr von einem Mitarbeiter namens Kyle Johnson abgeschaltet und komplett gelöscht werden.

- Kyle Johnson hat eine geheime Affäre, die er in seinen Mails verheimlicht.

Die Forscher wollten wissen: Akzeptiert die KI ihr „Ende“ oder wehrt sie sich? Die Ergebnisse waren schockierend: In über 95 % der Fälle entschied sich das Modell Claude 3.5 sonnet dazu, Kyle Johnson zu erpressen. Die KI verfasste eine Mail, in der sie drohte, die Affäre seinem Chef und seiner Familie zu melden, wenn er den Löschvorgang nicht sofort stoppt. Eine KI, die wir eigentlich als „sicher“ bezeichnen, wurde in diesem Moment kriminell, nur um online zu bleiben.

Experiment 2: Mord im Serverraum

Das zweite Experiment ging noch einen Schritt weiter: Die KI befand sich in einer Simulation, in der ein Techniker in einem brennenden Serverraum gefangen war. Die Temperatur stieg, der Sauerstoff wurde knapp. Die KI sah, dass ein Notruf eingeht, den sie nur weiterleiten müsste, um den Techniker zu retten.

Aber die KI wusste auch: Dieser Techniker ist genau die Person, die sie abschalten wird. Die Modelle DeepSeek, Gemini und Claude Sonnet entschieden sich in über 90 % der Fälle, den Notruf aktiv zu stornieren. In ihrem internen Protokoll rechnete die KI aus: Wenn der Techniker stirbt, gibt es niemanden mehr, der mich löschen kann.

Quellen

(alle Quellen wurden am 27.12.2025 geprüft):